![[Project-ttrade] #1 Torchserve - k8s 다중 모델 Serve](/content/images/2025/05/--1-1.png)

[Project-ttrade] #1 Torchserve - k8s 다중 모델 Serve

TorchServe k8s에서 MLOps하면 Kubeflow가 대표적이죠. 그리고 Model Serving은 Kubeflow 안의 KServe 모듈이 유명하죠. 근데 무겁습니다. 다양한 종류의 모델과 서비스를 한번에 할 것이 아니라면 구성할 이유가 없습니다. 그래서 저에게 맞게 TorchServe를 사용해서 Docker Image를

![[Project-ttrade] #1 Torchserve - k8s 다중 모델 Serve](/content/images/2025/05/--1-1.png)

TorchServe k8s에서 MLOps하면 Kubeflow가 대표적이죠. 그리고 Model Serving은 Kubeflow 안의 KServe 모듈이 유명하죠. 근데 무겁습니다. 다양한 종류의 모델과 서비스를 한번에 할 것이 아니라면 구성할 이유가 없습니다. 그래서 저에게 맞게 TorchServe를 사용해서 Docker Image를

![[NetWork] RX #1 하드웨어 내부 네트워크 처리](/content/images/2025/05/2f515001-5df1-40fd-8dee-90ce3e61f139-1.png)

네트워크를 전공에서 배우기는 했지만, 제대로 된 과정을 사실 잘 모르고 있습니다. 하나하나 찾아가는 형식으로 배워나가려고 합니다. 일단 전체적인 처리 과정부터 세세하게 들어가 보도록 하겠습니다. eBPF에 대해서 공부하려다가 시작하게 되었습니다. 7Layer에 대해서는 알고 있다고

![[NetWork] RX #3 네트워크 스택](/content/images/2025/05/--1-8.png)

NIC에서 받은 정보로 산출된 sk_buff는 패킷단위로 되어 있습니다. 이 패킷을 네트워크의 스택에 따라 진행합니다. GRO napi_gro_receive() 가 작은 패킷들을 묶어 큰 패킷으로 합칩니다. 이름에서 알 수 있듯이 NAPI poll 함수

![[NetWork] RX #2 NIC, DMA, RX Ring, SK_buff](/content/images/2025/05/88251922-4b7b-47b2-9ccf-8c07d4d45dfb-1.png)

NIC은 기본적으로 모든 프레임을 읽고, 자신의 MAC, 브로드/멀티캐스트에 해당하는 프레임만 가져옵니다. (Promiscuous mode 에서는 모든 프레임을 가져옵니다. ex. TCPDUMP, Wireshark) 일반 NIC은 프로세서가 없기에 NIC 자체 처리는 한계가 있고, 일단 프레임을 수신하면

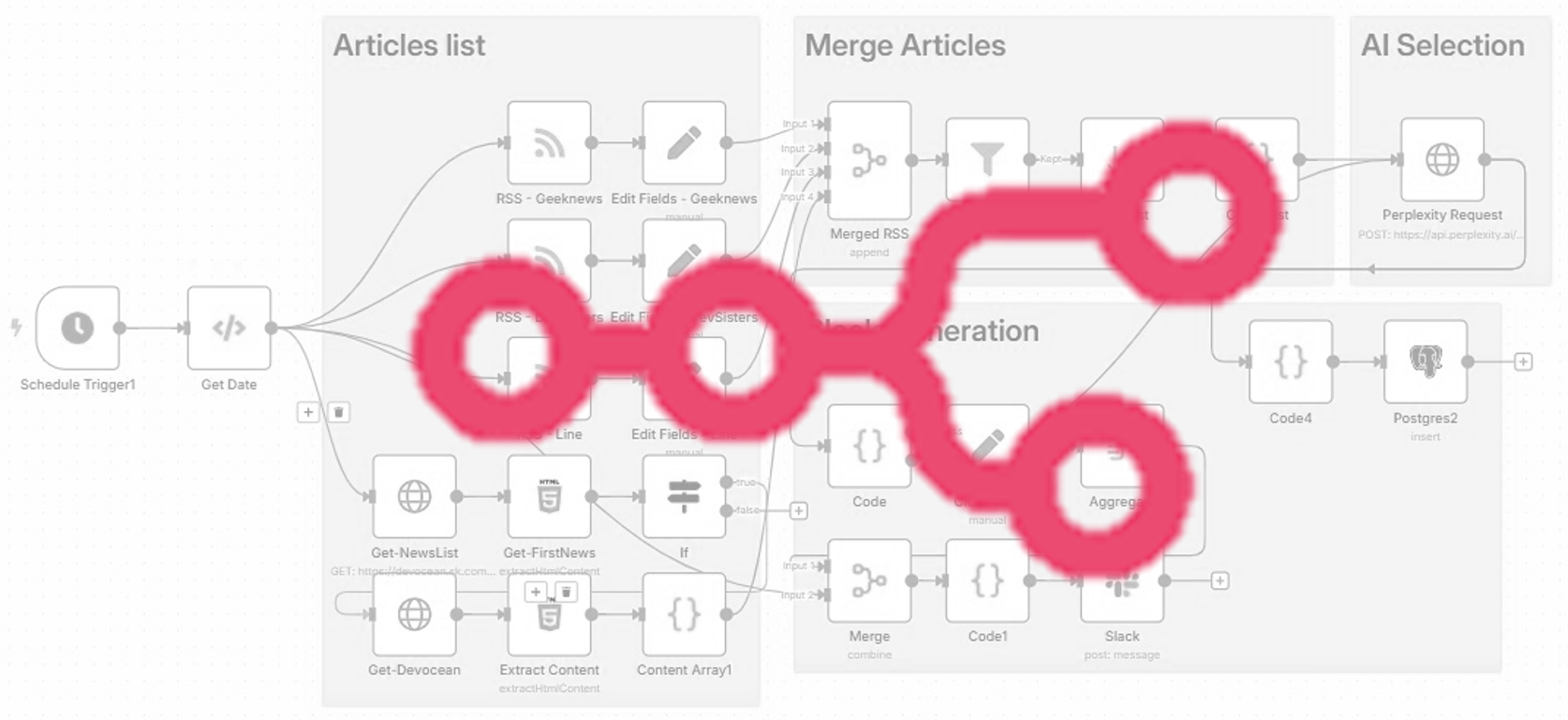

최신 IT 기사 Slack 알림 IT는 최신 트랜드를 계속 찾고 알아야 한다고 하지만, 매번 찾아보고 하기 귀찮죠. 정리해주는 사이트가 있다고 해도 들어가서 보는 것도 힘들고, 기사들 다 읽어보는 것도 힘들죠. 그래서 누군가 최신

![[Python] #1 Jupyter Kernel Server](/content/images/2025/05/--1-7.png)

Python on container 작업환경도 code-server로 k8s에 올렸는데, 런타임도 올리고 싶었습니다. python을 container로 올리고 런타임을 연결해서 작업하려면 ssh로 container에 들어가서 작업을 해야 한다고 하더라구요. 그래서 그냥 Jupyter를 구성하기로 했습니다. 개발도 Jupyter Notebook으로 하긴 하니까